Етичні норми і штучний інтелект в журналістиці: як дружити одразу з обома

Вікторія Піх

Опубліковано: 20-02-2024

Розділи: Нові технології медіа.

0

Етика відіграє важливу роль у будь-якій робочій діяльності, і звісно журналістика не виняток, а особливо в такий період, коли штучний інтелект інтенсивно прогресує у виконанні функцій журналістів.

Журналістська етика – це конкретний набір правил та норм поведінки, які має дотримуватися кожен, хто береться до збору, обробки та поширення інформації.

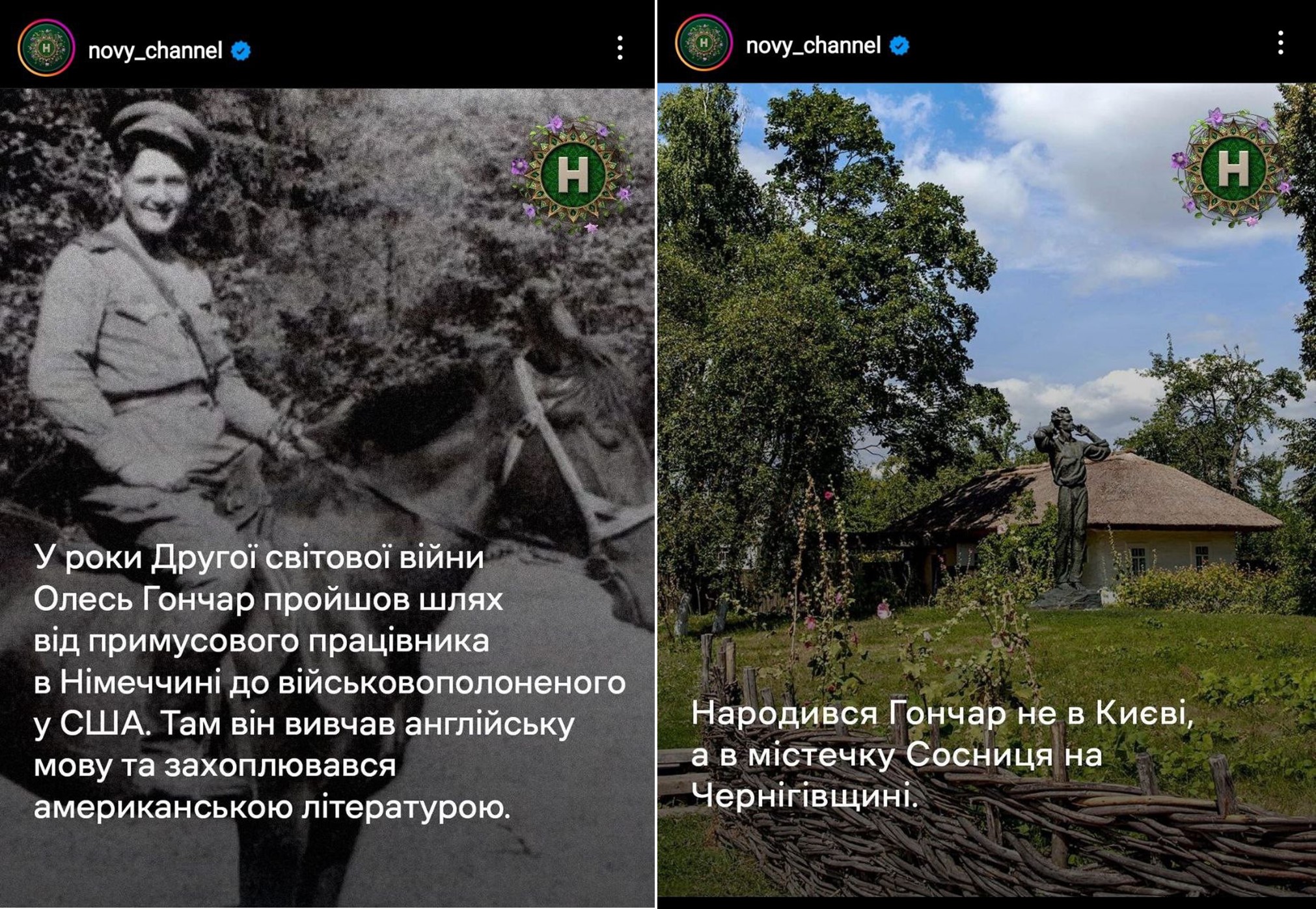

Сьогодні ШІ (штучний інтелект) сміливо застосовують для рерайту, копірайтингу, редагування тексту та навіть збору інформації. Варто розуміти, що машини теж схильні до помилок, як і звичайні журналісти. Наприклад, згадаймо як телеканал “Новий”, створивши сюжет до 105 річниці з дня народження українського письменника Олеся Гончара, поширив фейкову інформацію. На своїй сторінці в Instagram “Новий канал” опублікував допис з маловідомими фактами про Олеся Гончара: як виявилося, скориставшись ChatGPT, який подав неправдиву інформацію. Про це зізнався сам телеканал і вибачився за поширення фейкових фактів.

Фото: Детектор медіа

Або згадаймо скандальний пост з Twitter-акаунту Верховної Ради про трагедію у Дніпрі, проілюстрований реалістичним зображенням дитини, яке було згенероване ШІ.

Фото : Twitter

Після таких казусів залишається багато питань, зокрема, як не втратити довіру споживачів до медіа, після таких грубих помилок; хто несе відповідальність за поширення подібного контенту; та як не впасти обличчям в багно, використовуючи в журналістській діяльності функціонал штучного інтелекту?

Штучним інтелектом потрібно вміти користуватися і мати чітке усвідомлення його алгоритмів.

“Використання та розвиток систем ШІ у сфері медіа доцільно здійснювати з урахуванням основних цінностей журналістської етики, включно з правдивістю й точністю, неупередженістю та незалежністю, не нанесенням шкоди, не дискримінацією, підзвітністю, інклюзивністю, повагою до приватного життя, конфіденційністю джерел та іншими принципами, передбаченими Кодексом етики українського журналіста”, – рекомендує Національна рада України з питань телебачення та радіомовлення.

Насправді в Україні міністерство цифрової трансформації старанно оновлюється, створюючи нові проєкти, які мають на меті зробити так, аби ШІ допомагало суспільству, а не створювало додаткові загрози.

«Штучний інтелект активно використовується для створення контенту в промислових масштабах, включаючи сферу медіа. Проте стандарти взаємодії з нейромережами ще не повністю визначені. Тому ми розробили рекомендації, які пояснюють, як медіа повинні співпрацювати з системами штучного інтелекту, щоб уникнути ризиків, пов’язаних із ШІ, і запобігти фінансовим та репутаційним збиткам. Від поширення фейків та дезінформації до дискримінації та соціального ранжування. Ми хочемо, аби українські медіа розуміли, що AI — це все ж інструмент у руках людини. Великою мірою він не ідеальний, тому потрібно відповідально використовувати його в роботі. Як саме — відповіді у документі», — розповідає Віцепрем’єр-міністр з інновацій, розвитку освіти, науки та технологій — Міністр цифрової трансформації Михайло Федоров.

Та нарешті хто повинен нести відповідальність за припущені помилки штучного інтелекту? На це питання також знаходимо відповідь у документі Комісії з журналістської етики:

“Відповідно до Рекомендацій Комісії з журналістської етики щодо використання штучного інтелекту для створення журналістських матеріалів відповідальність за журналістський матеріал лежить на авторі й на редакції, навіть якщо під час підготовки цього матеріалу автор звертався за допомогою до ШІ”.

Вікторія Піх, студентка факультету журналістики ЛНУ ім. Івана Франка