Безпека чи відповідальність? Коментуємо проект ЄС “Білої книги для штучного інтелекту”

Анастасія Апетик

Опубліковано: 04-02-2020

Розділи: Огляди, аналітика.

0

Європейський союз розглядає можливість на 5 років заборонити технології розпізнавання облич у громадських місцях, щоби за цей час держави могли виробити правила, для врегулювання питань пов’язаних із використанням штучного інтелекту.

Експертка з інформаційного права Анастасія Апетик відповідає на питання, чи справді заборонять використовувати технологію розпізнавання обличчя і для чого це потрібно ЄС?

Насправді, Європейська комісія підготувала проєкт Білої книги, що пропонує 5 регуляторних рішень для штучного інтелекту:

1.Добровільне маркування. Це означає, що компанії, які планують використовувати технологію розпізнавання облич, добровільно заявляють про дотримання певних правил, після чого ЄС присвоює їм спеціальну «марку довіри».

2.Секторальні вимоги для державного управління та розпізнавання облич — цей варіант стосується використання технології розпізнавання облич у державних установах: пропонується адаптувати відповідні положення Регламенту GDPR.

3.Введення законодавчих обмежень лише для тих випадків використання штучного інтелекту, які пов’язані з високим рівнем ризику — охорона здоров’я, транспорт, правоохоронна діяльність, судова діяльність тощо.

4.Безпека та відповідальність — в цьому контексті метою використання штучного інтелекту може бути захист прав людей унаслідок кібератак, загроз персональним даним.

5.Урядування — йдеться про зобов’язання ввести на рівні ЄС ефективну систему впровадження ухвалених рішень.

Для чого потрібна заборона?

Заборона дасть змогу регуляторам здобути час, щоби наздогнати швидкий технологічний сектор та прийняти низку нормативних актів. Наразі це може трохи негативно вплинути на плани Німеччини провести розпізнавання обличчя на 134 залізничних станціях та 14 аеропортах. Франція також хоче створити правову основу для впровадження системи розпізнавання обличчя у свої системи відеоспостереження.

Як прокоментували цей документ у ЄС?

Речник Єврокомісії відмовився коментувати проєкт Білої книги та лише додав, що «Технологія повинна слугувати відповідно до призначення та допомагати людям. Тому довіра та безпека будуть у центрі уваги стратегії ЄС», — зауважив він. Остаточна версія документа мусить бути опублікована комісією у лютому, проте обов’язкові правила будуть запропоновані пізніше.

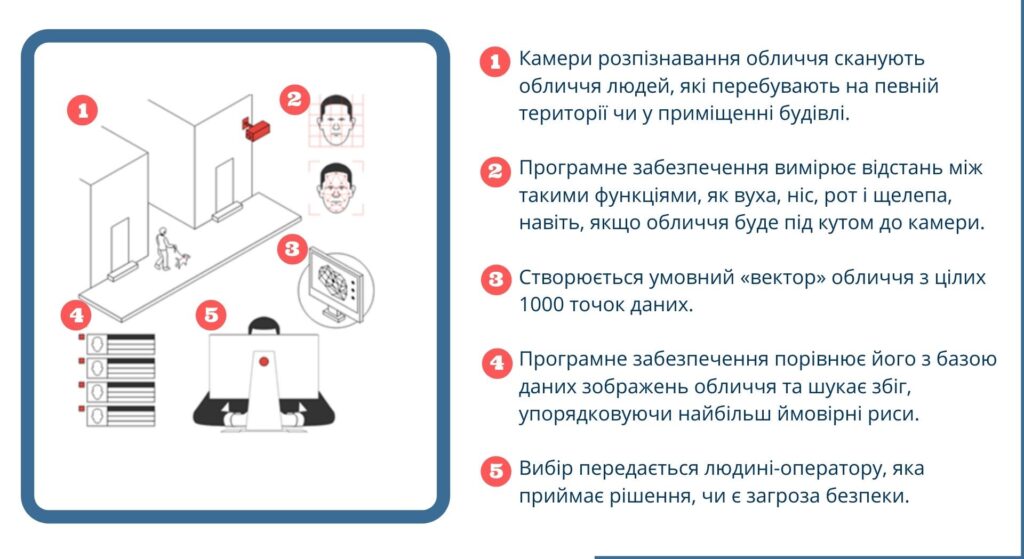

Як взагалі працює система розпізнавання обличчя?

1.Камери розпізнавання обличчя сканують обличчя людей, які перебувають на певній території чи у приміщенні будівлі.

2.Програмне забезпечення вимірює відстань між такими функціями, як вуха, ніс, рот і щелепа, навіть, якщо обличчя буде під кутом до камери.

3.Створюється умовний «вектор» обличчя з цілих 1000 точок даних.

4.Програмне забезпечення порівнює його з базою даних зображень обличчя та шукає збіг, упорядковуючи найбільш ймовірні риси.

5.Вибір передається людині-оператору, яка приймає рішення, чи є загроза безпеки.

Як це виглядатиме дивіться на схемі:

Чи є наявні кейси із незаконним використанням системи розпізнавання обличчя у світі?

Звісно є. До прикладу, минулого року Шведське відомство із захисту даних оштрафувало муніципалітет у розмірі 200 000 шведських крон ($20 700) за використання технології розпізнавання обличчя для контролю за відвідуванням учнів у школі. Французький регулятор даних заявив, що технологія порушує правила даних ЄС.

Місцева влада Скеллефтеа незаконно обробила чутливі біометричні дані, а також не виконала належної оцінки впливу, яка б включала консультації з регулятором та отримання попереднього схвалення.

Хоча школа забезпечила згоду батьків на моніторинг учнів, регулятор не вважав, що це юридично адекватна причина для збору таких персональних даних.

Регулятор зазначив, що деякі частини школи можна вважати «громадськими просторами», водночас, коли учні перебувають в класі, вони мають право на приватність. У рішенні йдеться про те, що є інші способи для фіксування відвідування навчального закладу, тому можна було б обійтися без участі камерного спостереження.

Крім цього випадку, за даними дослідження Big Brother Watch, у Британії технологія розпізнавання особи таємно застосовується в торгових центрах, музеях та місцях проведення конференцій.

У дослідженні описана ситуація, коли 14-річна дитина, одягнена в шкільну форму, була невірно ідентифікована системою розпізнавання обличчя та згодом – оточена чотирма поліцейськими в цивільному одязі. Її витягнули на бічну вулицю, тримали руки, допитували, просили телефон, і навіть, брали відбитки пальців. Коли поліція зрозуміла, що «система» помилилась, дитину звільнили за десять хвилин. Проте дитина залишилася наляканою і сказала, що відчуває, ніби її тепер переслідують поліцейські.

Яка ситуація в Україні із використанням систем відео- фіксації та розпізнавання обличчя?

Поки нам бракує належного регулювання в цій сфері. Так, згідно з Конституцією, не допускається збирання, зберігання, використання та поширення конфіденційної інформації про особу без її згоди, крім випадків, визначених законом, і лише в інтересах захисту національної безпеки, економічного добробуту та прав людини.

Ми знаємо, що місцевий муніципалітет використовує камери спостереження.

До прикладу, в Києві діє понад 6200 камер відеоспостереження із системою розпізнавання обличчя, проте, на якій підставі органи місцевого самоврядування використовують камери відеоспостереження — незрозуміло. Жодного закону, який передбачає повноваження місцевої влади щодо використання камери спостереження, на жаль, поки немає.

Водночас поліція може використовувати інформацію, здобуту від систем відеоспостереження, що розташовані на території чужого володіння. Зокрема, стаття 25 Закону України «Про Національну поліцію» містить положення, що поліція може користуватися базами (банками) даних МВС та інших органів державної влади. Загальновідомо, що органи місцевого самоврядування та комунальні підприємства до органів державної влади не належать.

Такі прогалини необхідно виправляти та розробляти документи, які регулюватимуть питання доступу до систем відеоспостереження та обробки персональних даних.

Авторка: Анастасія Апетик, експертка з інформаційного права

Джерело: Експертний центр з прав людини