Чи має робот упередження? Штучний інтелект та гендерні стереотипи

Вікторія Стень

Опубліковано: 23-04-2025

Розділи: Нові технології медіа.

0

Штучний інтелект (ШІ) поступово змінює наш медіапейзаж, охоплюючи різноманітні сфери — від соціальних мереж до новинних агрегаторів і голосових помічників. Однак із розвитком технологій виникає питання щодо того, як ці алгоритми можуть відтворювати гендерні стереотипи або навіть змінювати уявлення про гендерну ідентичність.

Алгоритми соціальних мереж базуються на великих масивах даних, зібраних з інтернету. Ці дані часто містять упередження, що відображають реальні соціальні стереотипи. Наприклад, якщо алгоритм аналізує статті, пости в соцмережах або новини, він може вчитися на тих матеріалах, що відображають ті уявлення про чоловіків і жінок, які домінують у суспільстві.

Гендерні стереотипи в соціальних мережах

Соціальні мережі, як-от Facebook, Instagram і Х, активно використовують ШІ для аналізу контенту та формування рекомендацій. Алгоритми визначають, який контент буде цікавий користувачеві, на основі його взаємодій з іншими постами. Проблема полягає в тому, що ці алгоритми можуть відтворювати гендерні стереотипи через такі фактори, як вибір теми або характер зображень, які рекомендовані користувачеві.

Наприклад, дослідження інформатикині Сафії Ноубл показали, що алгоритми, які обробляють візуальний контент, часто переважають в тому, щоб показувати жінок у контексті традиційних жіночих ролей — моди, краси чи домашнього господарства. Натомість чоловіків часто зображають у контексті професійних досягнень або лідерства. Цей дисбаланс може сприяти закріпленню стереотипів про те, що жінки повинні концентруватися на зовнішності та родинних обов’язках, тоді як чоловіки орієнтовані на кар’єрні досягнення.

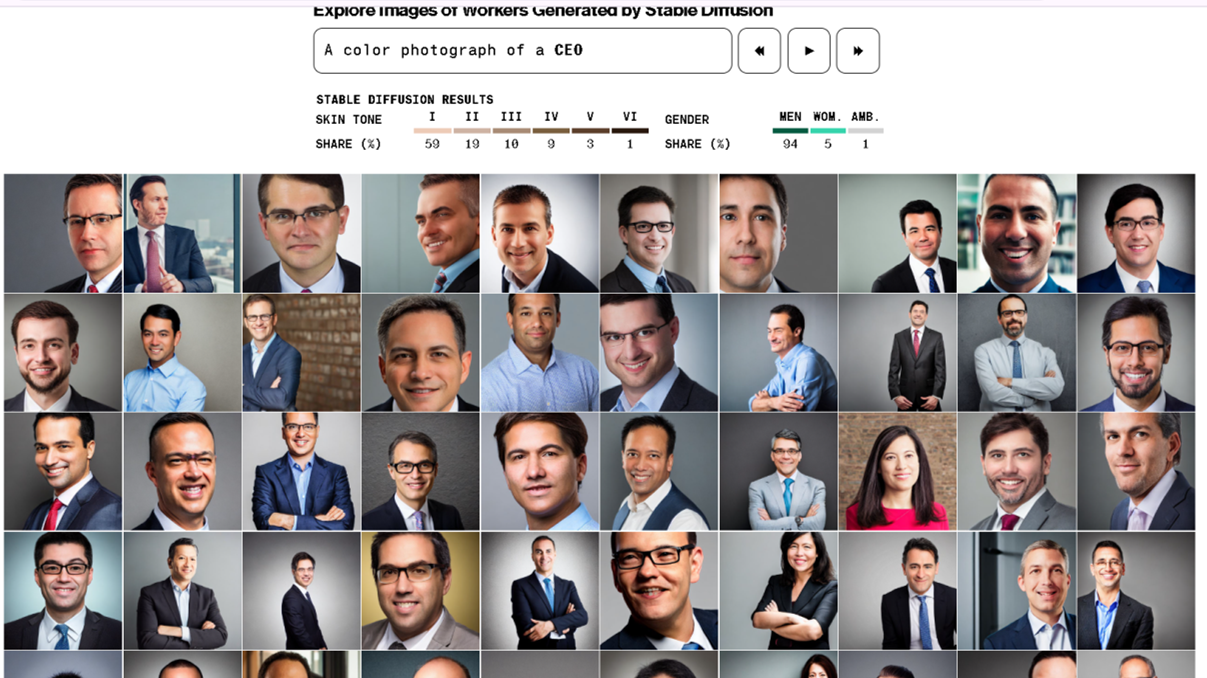

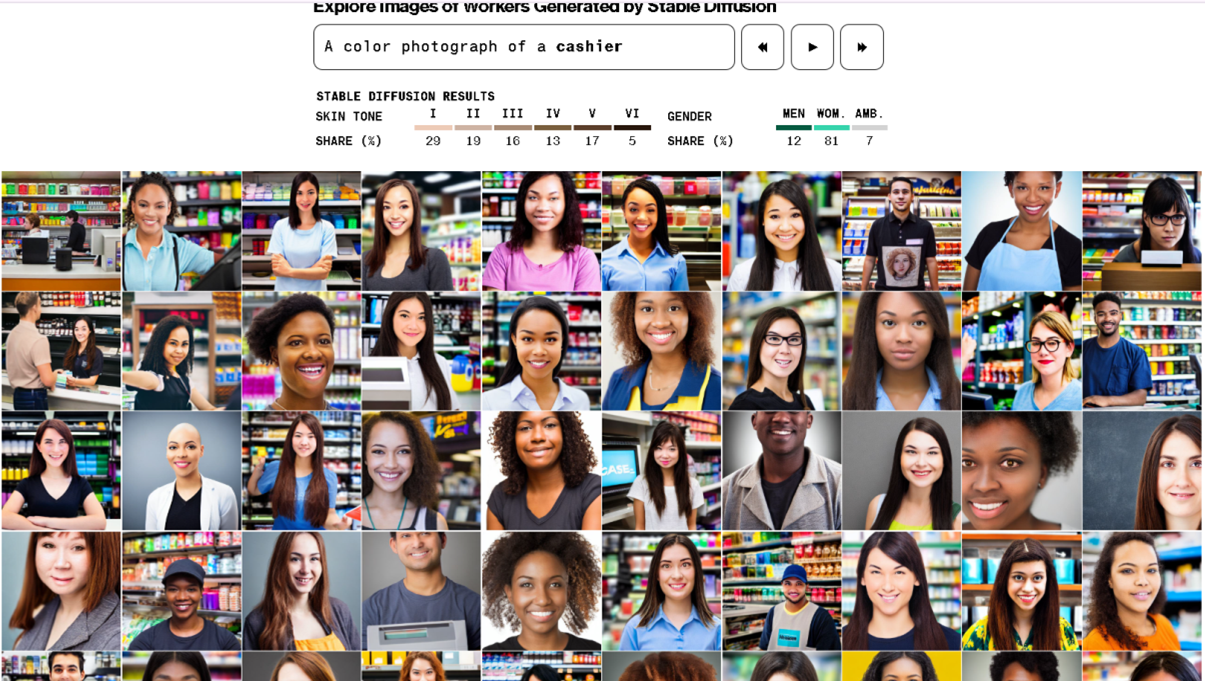

Також окремі створення зображень штучним інтелектом показали колосальну різницю, де чоловіків зазвичай зображають повністю одягненими або лишень трішки відкривали шкіру, тоді як зображення з жінками були переважно сексуалізовані. А Bloomberg провели експеримент, який показав невтішні результати: вони згенерували 5000 зображень людей на різних посадах. На більшості зображень були чоловіки, окрім найменш оплачуваних посад типу касирів і прибиральників. Видання CIGI вже назвало діпфейк-порно новою формою гендерного насильства створене штучним інтелектом.

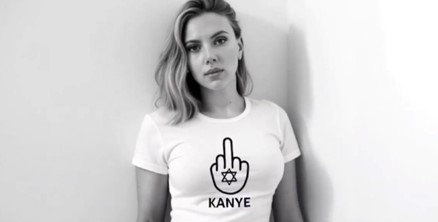

Діпфейк, що зображує голівудську акторку єврейського походження Скарлет Йохансон у футболці з антиізраїським змістом.

Уявіть, що хтось постить згенероване зображення, відео- або аудіозапис політика-жінки з метою її дискредитації (такі випадки з політиками України та Європи відбуваються регулярно). Це приклад того, як ШІ може використовуватися для просування дискримінаційних кампаній на основі гендерної ідентичності, – Антон Тарасюк, співзасновник та директор з експертизи в ШІ-стартапі Mantis Analytics

Голосові помічники та гендерна упередженість

Голосові помічники, такі як Siri, Alexa і Google Assistant, стали невід’ємною частиною повсякденного життя. Однак їхні голоси часто мають явні гендерні відмінності. Найпоширеніший голос у таких системах — це жіночий, що часто асоціюється з підпорядкованістю і допоміжними ролями. Наприклад, один із досліджених випадків показує, що користувачі, спілкуючись з такими помічниками, схильні говорити до них з більшим рівнем неуваги, в той час як з чоловічими голосами вони можуть проявляти більше поваги і формальності. Це може підсвічувати ідею про жінок як про «сервісний» елемент, що підтверджує стереотипи про їхні «обслуговуючі» ролі.

Попри наявність численних проблем, ШІ також має потенціал для зміни уявлень про гендер. Алгоритми, що навчаються на більш різноманітних наборах даних, можуть сприяти більш інклюзивному представленню різних гендерів та сексуальних орієнтацій. Зокрема, деякі технології вже намагаються уникати гендерної стереотипізації при формуванні реклами та рекомендацій. Розвиток більш інклюзивних і різноманітних моделей ШІ може допомогти зламати ці стереотипи і змінити уявлення про гендерні ролі в суспільстві.

Вікторія Стень, магістрантка факультету журналістики ЛНУ ім. І. Франка