ШІ допомагає чи заважає? Як сьогодні викривають фейки

Христина Левус

Опубліковано: 25-02-2026

Розділи: Нові технології медіа.

0

Ще кілька років тому для створення переконливого фейкового відео потрібні були спеціальні навички, час і доступ до складного програмного забезпечення. Сьогодні ж достатньо кількох кліків і в мережі з’являється виступ політика, зі словами, яких він не говорив, або репортаж з події, що ніколи насправді не відбувалася. Штучний інтелект різко здешевив і прискорив виробництво дезінформації, водночас зробивши її значно переконливішою для масової аудиторії.

Отож, фейків стало більше, а чи побільшало способів їх викривати?

Нові форми фейків у добу штучного інтелекту

ШІ, окрім того, що допомагає створювати фейки швидше, загалом змінює сам принцип їхнього сприйняття.

Однією з найбільш тривожних форм сучасної дезінформації стають deepfake-відео та аудіо. Завдяки генеративним алгоритмам сьогодні можливо відтворити обличчя, міміку або голос конкретної людини з досить високою точністю. Навіть, якщо зараз пересічний глядач ще здатен відрізнити deepfake від справжнього відео, то швидше за все, не зможе цього зробити вже в найближчі роки, враховуючи прогресію з якою розвивається ШІ. Це створює принципово нову загрозу: відео більше не гарантує правдивості. А отож під удар потрапляє сама ідея візуального підтвердження фактів, а суспільна довіра до медіаконтенту поступово розмивається.

Найбільш поширеними є гібридні фейки, коли алгоритми генерують основу контенту, а люди адаптують його до конкретної аудиторії, культурного контексту або політичної ситуації.

Проблематика в Україні

Досить гостро проблематика автоматизації створення фейків постає в Україні, адже в період, коли пропаганда прямо впливає на моральний стан суспільства, економіку, ситуацію на політичному полі та заразом на перебіг інформаційної війни – питання протидії та розпізнання фейків постає особливо гостро.

За останніми дослідженнями ДетекторМедіа, якщо у 2021 році лише 55% українців мали високий і вищий за середній рівень чутливості до дезінформації, маніпулятивного контенту та замовних матеріалів, то у 2024 році ця частка становить 68%.

Отож, як діяти журналістам сьогодні?

Міжнародні медіа, наприклад, вже інвестують у фактчекінг як в окремий напрям журналістської роботи. Агентство AFP (Agence France Presse) має спеціалізований підрозділ AFP Fact Check, журналісти якого постійно перевіряють сумнівний контент, що є впливовим та потенційно шкідливими для громадськості. Їхня робота – це поєднання класичних журналістських методів (пошук першоджерел, аналіз контексту, геолокація, робота з відкритими даними) та нових технологічних інструментів.

Поворот до технологій: надія чи ілюзія?

На тлі вибухового розвитку генеративного ШІ з’являється дедалі більше систем, баз даних і програм, покликаних допомогти журналістам виявляти фейки, в тому числі створені ШІ.

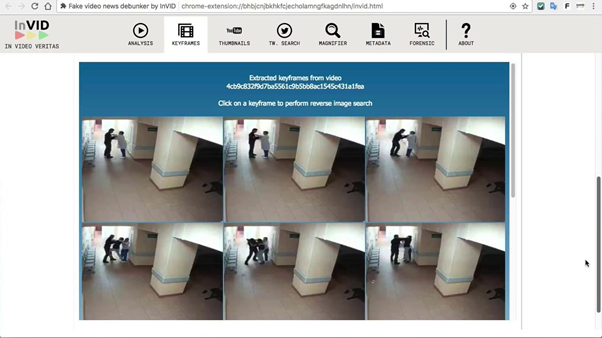

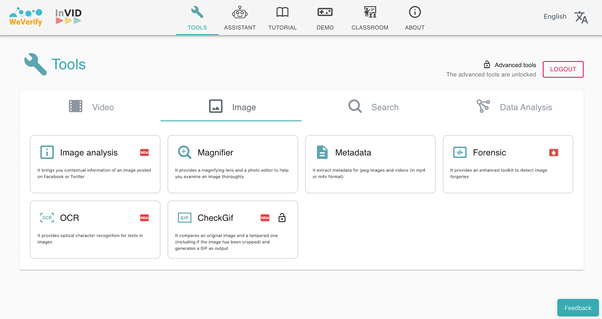

Одним із найбільш зручних та вживаних інструментів для перевірки відеоконтенту в журналістській практиці є плагін InVID-WeVerify. Він дозволяє отримувати контекстну інформацію про відеоролики, опубліковані на YouTube, Facebook, Instagram, X (Twitter) та DailyMotion. Інструмент розбиває відео на ключові кадри й автоматично здійснює зворотний пошук кожного з них через пошукові системи. Такий пошук дає змогу знайти оригінальне джерело зображення, встановити, де й коли ці кадри з’являлися раніше, а також виявити повторне використання відео в іншому, маніпулятивному контексті. Крім того, інструмент дає змогу аналізувати метадані файлу, що може підказати час створення ролику або платформу, з якої він походить.

Інструмент у роботі можна оглянути тут.

Саме цей плагін був спільно розроблений за участі AFP і активно використовується журналістами агентства для первинної перевірки відео й фото. Він значно пришвидшує роботу, яку журналіст раніше міг виконувати годинами.

Паралельно з такими інструментами з’являються і спеціалізовані детектори ШІ-контенту, які обіцяють автоматично визначати, чи було зображення або відео створене штучним інтелектом. Наприклад, AI or Not, платформа, що покликана аналізувати візуальні ознаки синтетичності. Однак щодо точності результатів наразі можна сперечатись, стовідсоткової правильності програми та їх розробники не гарантують, особливо з огляду на швидкий розвиток генеративних моделей.

Спробою відповісти на сучасні виклики також стала ініціатива TrueMedia. Це організація, заснована доктором Ореном Етціоні, почесним професором комп’ютерних наук Університету Вашингтона та генеральним директором-засновником Інституту штучного інтелекту Аллена. TrueMedia працює над виявленням і маркуванням дипфейків та неправдивого контенту, який поширюється у соціальних мережах, залучаючи до цього дослідників Школи Маккорта, Інституту масивних даних (MDI) та Програми технологій і державної політики (TPP). Засновник проєкту формулює його ідею як спробу використати ШІ для боротьби з ШІ, вважаючи, що алгоритми можуть допомогти відновити довіру до того, що користувачі бачать і чують в Інтернеті.

Інший підхід до протидії ШІ-фейкам пропонує Political Deepfakes Incidents Database (PDID) – база даних політичних інцидентів, пов’язаних із використанням дипфейків. Вона охоплює як складні синтетично створені відео та зображення, так і менш технологічні «cheapfake», у яких маніпуляція досягається простішими засобами.

PDID містить не лише сам контент, а й детальні метадані та дескриптори, закодовані дослідниками з галузей політології, комунікації, державної політики та досліджень дезінформації. База має на меті виявляти тенденції, масштаби поширення та потенційний вплив політичних дипфейків, зокрема тих, що стосуються ключових політичних фігур або знакових подій. Журналісти та організації з перевірки фактів можуть використовувати PDID для перехресної перевірки автентичності контенту, а також для аналітики й звітування про загальні тренди. Збір даних розпочався у червні 2023 року, однак база вже включає інциденти, зафіксовані починаючи з 2017 року, і продовжує поповнюватися.

Можливо в майбутньому існуватиме більша кількість ресурсів, що допомагатимуть ефективно боротись з фейками. А можливо будуть введені конкретні правила та навіть закони щодо вживання ШІ і контент, створений нейромережами, буде суворо обмеженим водяними знаками чи будь-якою іншою системою їхнього розпізнавання. Втім, станом на сьогодні кількості ефективних інструментів для повноцінного виявлення фейків недостатньо: вони лише продовжують створюватися, впроваджуватися в користування та вдосконалюватися, але не здатні повністю замінити людський аналіз і критичне мислення. Відповідальність за виявлення маніпулятивного контенту продовжує покладатися на журналістів, редакції та дослідників, яким уже сьогодні доводиться шукати власні інструменти й підходи для протидії дезінформації в умовах стрімкого розвитку ШІ.

Христина Левус, студентка факультету журналістики ЛНУ ім. Івана Франка